IA corporativa sem riscos: a importância de começar do jeito certo

Imagem:Canva

A inteligência artificial redefiniu as regras do jogo no setor financeiro — e errar na sua implementação pode custar caro em termos de tecnologia, reputação e futuro. Como a IA é implementada e os pilares que sustentam essa implementação farão toda a diferença entre uma transformação bem-sucedida e um passivo tecnológico e reputacional de longo prazo. Tratar a IA como mais uma camada de software ou como um simples plugin de produtividade é uma abordagem perigosa.

Os mercados financeiro e de capitais operam sob o princípio da confiança. Qualquer erro algorítmico que afete clientes, investidores ou a economia pode gerar consequências exponenciais. A responsabilidade sobre a IA está deixando de ser apenas técnica: entra no radar dos conselhos, das auditorias e dos reguladores.

Há motivo para isso: o AIID (AI Incident Database), uma base de dados dedicada a mapear problemas no mundo real gerados por sistemas falhos ou criminosos de IA, identificou crescimento de 56,4% do número de incidentes em 2024, comparado com 2023. Embora a classificação de incidentes seja intencionalmente abrangente — de um acidente provocado por um carro autônomo até o uso de um deepfake de celebridade para vender pílulas de emagrecimento — o boletim de fevereiro e março da AIID sinaliza o crescimento do uso de deepfakes com motivação financeira ou como instrumentos ativos de fraude contra pessoas, empresas e governos.

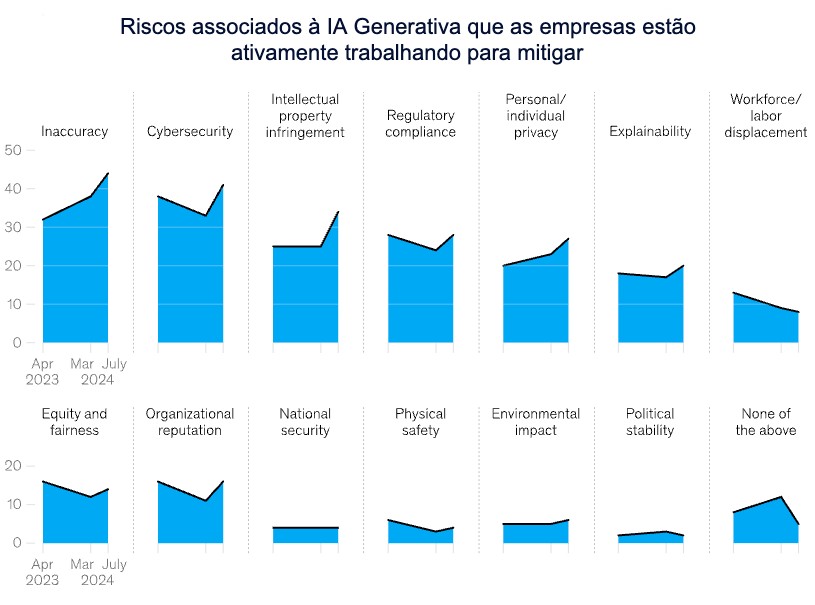

A edição de 2025 do relatório anual The State of AI, da McKinsey, identificou o crescimento da preocupação das empresas em mitigar problemas com seus sistemas de IA. Entre os mais elevados, estão cibersegurança, quebra de propriedade intelectual, conformidade regulatória e imprecisão (gráfico abaixo).

Fonte: Relatório McKinsey "The State of AI 2025"

Responsabilidade, transparência e controle

A IA precisa ser integrada a uma estratégia corporativa orientada por princípios de responsabilidade, transparência e controle. Nos mercados financeiro e de capitais, esse processo ganha ainda mais complexidade, especialmente se levarmos em conta questões de cibersegurança e conformidade regulatória. Dois relatórios recentes do BIS (Banco de Compensações Internacionais) reforçam esse alerta.

Os documentos — Regulating AI in the Financial Sector, de dezembro de 2024, e Governance of AI Adoption in Central Banks, de janeiro de 2025, apontam que, embora a IA ofereça ganhos claros de eficiência e inovação, a ausência de governança, segurança, conformidade regulatória e infraestrutura adequada pode amplificar riscos em vez de mitigá-los.

Os quatro pilares para um bom começo

Governança: a base para uma IA responsável

A ausência de uma estrutura de governança sólida pode levar a decisões automatizadas sem supervisão adequada, resultando em vieses algorítmicos e impactos negativos para os clientes. Segundo a IBM, a conformidade da IA envolve não apenas o cumprimento de requisitos legais, mas também a construção de confiança entre as partes interessadas, promovendo transparência e justiça nas decisões automatizadas .

Segurança: protegendo dados e sistemas

A segurança cibernética é uma preocupação crescente no uso da IA. O relatório Global Cybersecurity Outlook 2025, do WEF (Fórum Econômico Mundial), identificou que a IA generativa está levando a um aumento sem precedentes em fraudes cibernéticas e que duas em cada três organizações ouvidas declaram lacunas moderadas e críticas de habilidades da sua força de trabalho para atender os requisitos de segurança. Investir em medidas de segurança robustas e na especialização das equipes é fundamental para proteger dados sensíveis e manter a integridade dos sistemas.

Compliance: navegando em um cenário regulatório complexo

A conformidade regulatória é essencial para evitar sanções e manter a reputação institucional, mas a proliferação de requisitos regulatórios para a IA em todo o mundo traz uma carga adicional de conformidade para as organizações. A vigilância sobre a IA Responsável (RAI) ganhou caráter de urgência: em 2024, a cooperação global em governança de IA se intensificou, com organizações como a OCDE, a UE, a ONU e a União Africana lançando estruturas focadas em transparência, confiabilidade e outros princípios fundamentais de RAI.

O Projeto de Lei 2338/2023, em tramitação no Brasil, visa estabelecer normas para o desenvolvimento e uso responsável da IA, incluindo a criação do Sistema Nacional de Regulação e Governança de Inteligência Artificial. As instituições devem estar preparadas para atender a esses requisitos e adaptar-se às mudanças regulatórias.

Infraestrutura: a base técnica para a IA

Uma infraestrutura inadequada pode comprometer o desempenho e a escalabilidade dos sistemas de IA. As empresas de serviços financeiros devem priorizar a digitalização dos seus processos e a utilização da IA focando em pessoas, processos, dados e tecnologia para ter sucesso em um ambiente digital em constante evolução. Investir em infraestrutura tecnológica é crucial para suportar as demandas da IA e garantir sua eficácia.

Para o seu radar